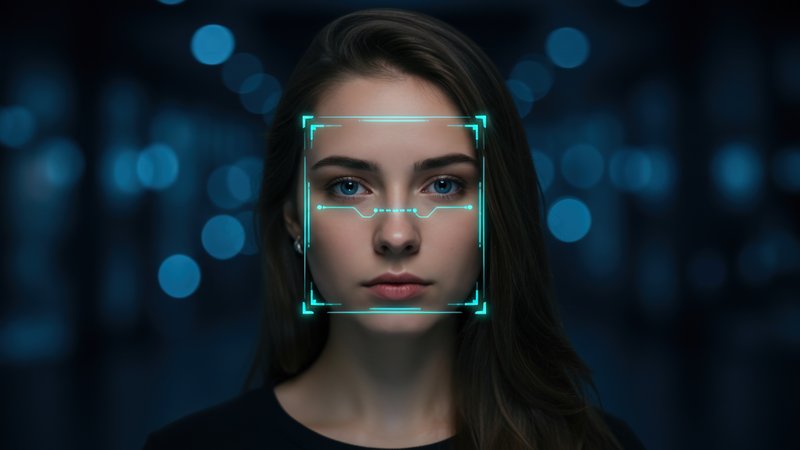

OkCupid dio a la empresa de reconocimiento facial Clarifai acceso a casi 3 millones de fotos de usuarios más datos de ubicación sin avisar a los usuarios ni obtener consentimiento, reveló la FTC en un acuerdo anunciado ayer. La empresa matriz de la app de citas Match Group acordó restricciones permanentes en el intercambio de datos pero no paga penalización financiera alguna por el incidente de 2014. Clarifai, que comercializa servicios de IA a clientes "militares, civiles, de inteligencia y gubernamentales", recibió los datos sin restricciones contractuales sobre cómo podrían usarse.

Este caso expone cómo los datos de entrenamiento de IA se cosechan de apps de consumo a través de acuerdos secretos que los usuarios nunca ven. Mientras las empresas de reconocimiento facial hablan públicamente sobre IA ética, están construyendo silenciosamente datasets de perfiles de citas, redes sociales y otras fuentes personales. La FTC encontró que OkCupid violó directamente su propia política de privacidad, que prometía no compartir información personal sin notificación al usuario y opciones de exclusión. Lo que es particularmente preocupante: OkCupid "tomó medidas extensivas para ocultar" el intercambio de datos e intentó obstruir la investigación de la FTC.

El acuerdo sin penalización refleja el enfoque de cumplimiento más ligero de la administración Trump—ambos comisionados demócratas de la FTC habían sido despedidos, dejando a los republicanos en control total. Esto establece un precedente preocupante donde las empresas pueden alimentar secretamente a firmas de IA con datos de usuarios, ser atrapadas años después, y salirse con solo una promesa de no hacerlo de nuevo. Para desarrolladores construyendo con API de reconocimiento facial, esto resalta la procedencia turbia de datos de entrenamiento de proveedores principales.

Si estás usando Clarifai o servicios similares, haz preguntas difíciles sobre fuentes de datos. Las fotos que alimentan tus modelos de IA podrían venir de apps de citas, redes sociales u otros servicios de consumo donde usuarios nunca consintieron al entrenamiento de IA. La respuesta débil de la FTC aquí básicamente da luz verde a esta práctica siempre que las empresas eventualmente prometan ser más transparentes.