Les institutions financières déploient discrètement la biométrie comportementale qui analyse les motifs neuronaux inconscients pour vérifier l'identité, dépassant les mots de passe traditionnels et contournant même les vulnérabilités de Face ID. Les chercheurs de UC Berkeley ont démontré qu'après avoir capturé seulement 11 mouvements de défilement, les modèles AI pouvaient identifier des utilisateurs spécifiques d'un groupe de 41 personnes avec une précision de 100%. La technologie suit 30 marqueurs comportementaux distincts incluant la vélocité des mouvements, la courbure de trajectoire, la zone de contact du doigt, et les motifs de défilement « balistiques » vs arrêt complet.

Ce virage reflète une crise plus profonde de la sécurité numérique alors que l'AI générative permet aux cybercriminels d'augmenter l'échelle des attaques qui défont l'authentification conventionnelle. Les Remote Access Trojans peuvent maintenant contourner l'authentification multi-facteurs, forçant les banques—qui sont légalement responsables des pertes de cyberfraude—à adopter l'analyse comportementale comme pratique standard. L'ironie est profonde : ce qui nous rend humains n'est pas nos décisions conscientes mais nos corrections d'erreurs neuronales inconscientes durant les gestes banals.

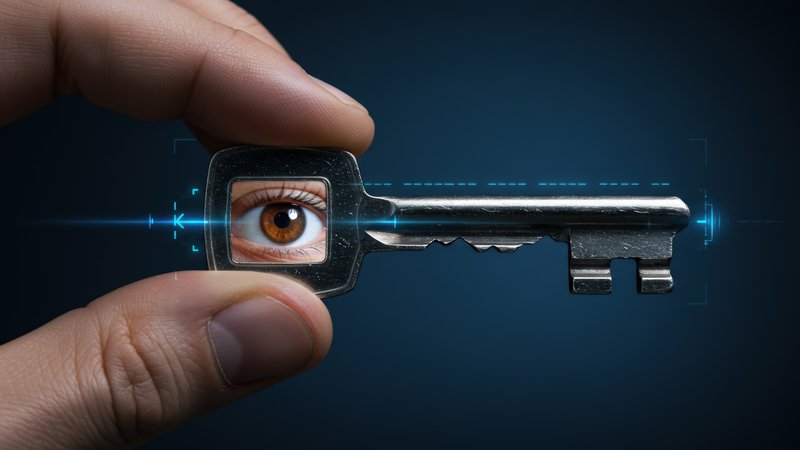

La théorie du contrôle moteur computationnel derrière cette technologie révèle quelque chose de troublant sur la vie privée. Chaque glissement, tape, et défilement crée une empreinte neuronale unique plus distinctive que les vraies empreintes digitales. Les banques peuvent détecter la fraude à partir de l'orientation de l'appareil (téléphones à l'envers durant les transactions), des vitesses de frappe impossibles, ou des mouvements de curseur non naturels. Mais ce même suivi comportemental granulaire signifie que les institutions surveillent maintenant la biomécanique subtile de comment vous tenez votre téléphone.

Pour les développeurs qui construisent des systèmes d'authentification, ceci représente à la fois une opportunité et une responsabilité. La biométrie comportementale offre de vraies améliorations de sécurité, mais elle crée aussi des capacités de surveillance sans précédent. La question n'est pas si cette technologie fonctionne—Berkeley l'a prouvé. La question est si nous sommes à l'aise avec des systèmes AI qui nous connaissent mieux que nous nous connaissons nous-mêmes.