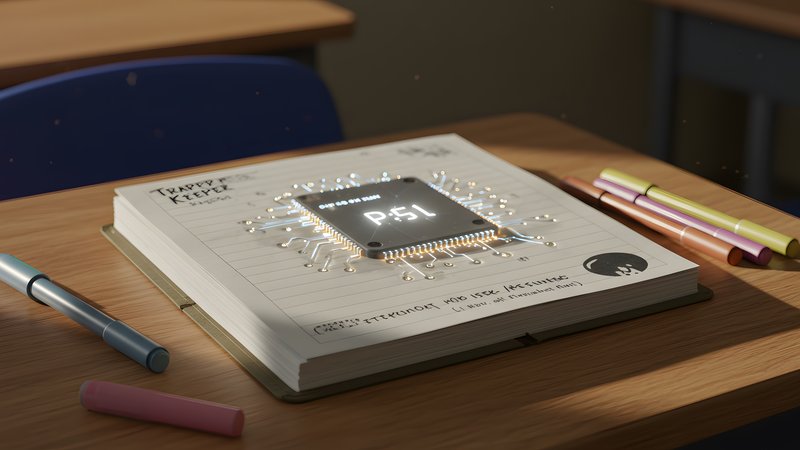

Les chercheurs de Google ont découvert qu'appliquer des transformations de coordonnées polaires—de la trigonométrie de base enseignée au secondaire—peut réduire l'utilisation mémoire du cache KV de 6x sur les NVIDIA H100 tout en offrant un boost de performance de 8x. La technique exploite les propriétés mathématiques des coordonnées polaires pour compresser le cache key-value que les modèles transformer utilisent pour stocker les poids d'attention durant l'inférence, réduisant drastiquement les exigences mémoire sans sacrifier la précision.

C'est important parce que le cache KV est le principal goulot d'étranglement mémoire pour les large language models en production. Chaque token généré nécessite de stocker les états d'attention précédents, et avec des fenêtres de contexte atteignant 128K+ tokens, la mémoire cache explose exponentiellement. Une réduction de 6x signifie que vous pouvez servir 6x plus d'utilisateurs sur le même matériel, ou faire rouler des modèles qui étaient auparavant impossibles à cause des contraintes mémoire. Pour les fournisseurs cloud qui brûlent leurs clusters H100, cette optimisation se traduit par des économies massives.

Le manque de couverture supplémentaire d'autres sources est révélateur—soit c'est tellement nouveau que la vérification est en attente, soit les détails techniques sont assez complexes que peu de médias ont l'expertise en infrastructure AI pour évaluer correctement les affirmations. La référence désinvolte du résumé RSS à « faire attention en cours de trigonométrie » sous-estime ce qui semble être de l'ingénierie mathématique sophistiquée, suggérant que la percée pourrait être plus accessible à implémenter qu'il n'y paraît initialement.

Les développeurs devraient surveiller si Google rend cette optimisation open-source ou l'intègre dans leur infrastructure de service. Si la technique fonctionne comme annoncé, attendez-vous à une adoption rapide dans l'industrie—toute optimisation qui offre 6x d'économies mémoire deviendra incontournable pour le service AI compétitif. La question n'est pas si ça va être adopté, mais à quelle vitesse les compétiteurs vont faire de la rétro-ingénierie et implémenter des approches similaires.