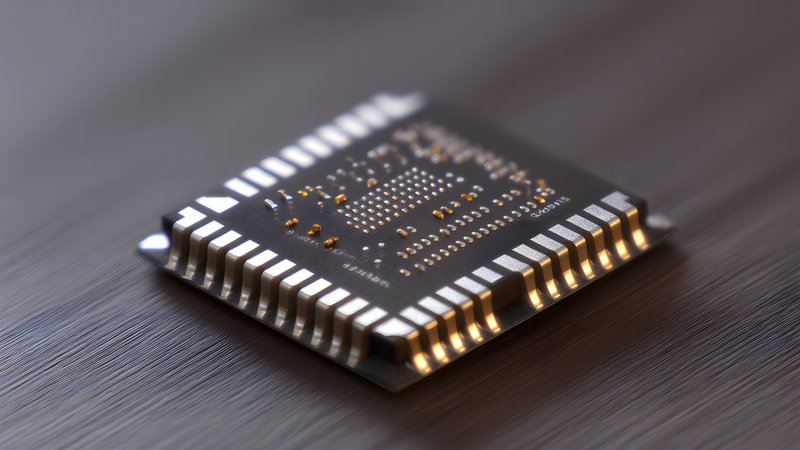

Nvidia a investi 2 milliards $ dans Marvell Technology, le concepteur de puces pour centres de données basé à Santa Clara, dans le cadre d'un partenariat stratégique couvrant plusieurs segments du marché des puces. L'investissement vise les capacités technologiques d'interconnexion de Marvell, qui gèrent les voies de données critiques entre les processeurs dans les systèmes IA.

Cette démarche signale que Nvidia reconnaît que la puissance de calcul brute ne suffit plus — le goulot d'étranglement s'est déplacé vers le déplacement efficace des données entre les puces et systèmes. Alors que les modèles IA gonflent en taille et que les clusters d'entraînement atteignent des dizaines de milliers de GPU, la couche d'interconnexion devient une infrastructure critique. L'expertise de Marvell en processeurs de centres de données et puces de réseau les positionne comme un acteur clé pour résoudre ce qui devient le défi d'infrastructure le plus coûteux de l'IA.

Le montant de 2 milliards $ suggère que ce n'est pas juste un investissement financier mais un pari stratégique sur le contrôle d'une plus grande partie de la pile IA. Bien que le reportage original manque de détails sur la collaboration technique spécifique ou les feuilles de route produits, le timing s'aligne avec les préoccupations sectorielles concernant les limitations de bande passante dans les déploiements IA à grande échelle. Sans sources supplémentaires fournissant des perspectives concurrentes, on a une visibilité limitée sur les implications réglementaires potentielles ou les réponses compétitives.

Pour les développeurs qui construisent des applications IA, ce partenariat pourrait éventuellement signifier de meilleures performances et des coûts plus bas pour les charges de travail d'entraînement et d'inférence distribuées. Mais n'attendez pas de bénéfices immédiats — les partenariats matériels comme celui-ci prennent typiquement 18-24 mois pour produire des produits expédiés qui comptent pour les déploiements de production.