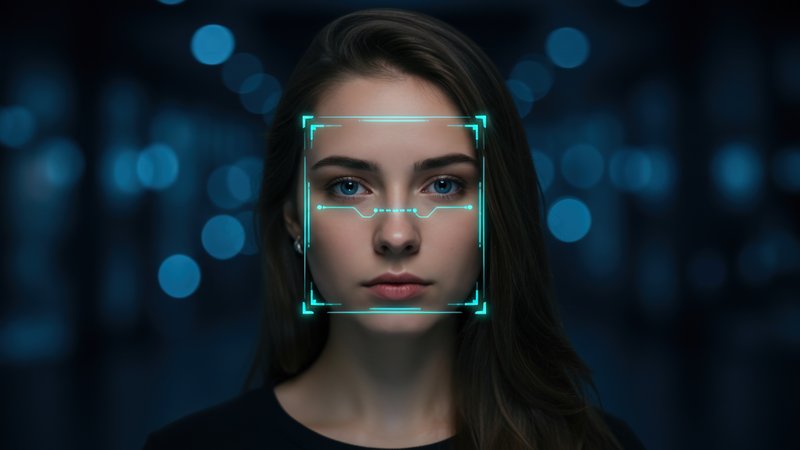

OkCupid a donné à la compagnie de reconnaissance faciale Clarifai l'accès à près de 3 millions de photos d'utilisateurs plus les données de localisation sans informer les utilisateurs ni obtenir leur consentement, a révélé la FTC dans un règlement annoncé hier. La société mère de l'app de rencontres Match Group a accepté des restrictions permanentes sur le partage de données mais ne paie aucune pénalité financière pour l'incident de 2014. Clarifai, qui commercialise des services d'IA auprès de clients « militaires, civils, de renseignement et gouvernementaux », a reçu les données sans aucune restriction contractuelle sur leur utilisation.

Ce cas expose comment les données d'entraînement d'IA sont récoltées des apps grand public à travers des ententes secrètes que les utilisateurs ne voient jamais. Alors que les compagnies de reconnaissance faciale parlent publiquement d'IA éthique, elles construisent discrètement des datasets à partir de profils de rencontres, médias sociaux et autres sources personnelles. La FTC a trouvé qu'OkCupid a directement violé sa propre politique de confidentialité, qui promettait de ne pas partager d'informations personnelles sans notification aux utilisateurs et options de retrait. Ce qui est particulièrement préoccupant : OkCupid a « pris des mesures extensives pour cacher » le partage de données et a tenté d'obstruer l'enquête de la FTC.

Le règlement sans pénalité reflète l'approche d'application plus légère de l'administration Trump—les deux commissaires démocrates de la FTC avaient été congédiés, laissant les républicains en plein contrôle. Ça crée un précédent troublant où les compagnies peuvent secrètement alimenter les firmes d'IA avec des données d'utilisateurs, se faire prendre des années plus tard, et s'en sortir avec juste une promesse de ne plus recommencer. Pour les développeurs qui construisent avec des API de reconnaissance faciale, ça souligne la provenance trouble des données d'entraînement des fournisseurs majeurs.

Si vous utilisez Clarifai ou des services similaires, posez des questions difficiles sur les sources de données. Les photos qui alimentent vos modèles d'IA pourraient provenir d'apps de rencontres, réseaux sociaux ou autres services grand public où les utilisateurs n'ont jamais consenti à l'entraînement d'IA. La réponse faible de la FTC ici donne essentiellement le feu vert à cette pratique tant que les compagnies promettent éventuellement d'être plus transparentes.