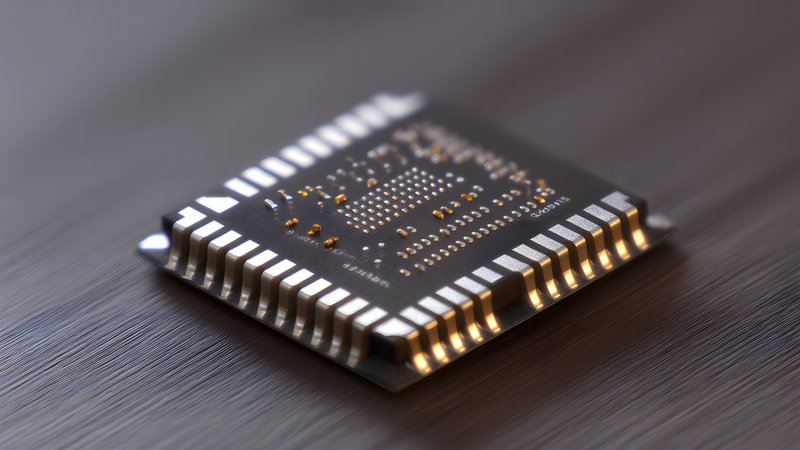

Nvidia ने Santa Clara स्थित data center chip डिजाइनर Marvell Technology में $2 बिलियन का निवेश किया है, एक रणनीतिक साझेदारी के हिस्से के रूप में जो कई chip market segments में फैली है। यह निवेश Marvell की interconnect technology क्षमताओं को लक्षित करता है, जो AI systems में processors के बीच महत्वपूर्ण data pathways को handle करती है।

यह कदम संकेत देता है कि Nvidia समझ गया है कि अब raw compute power पर्याप्त नहीं है — bottleneck chips और systems के बीच efficiently data move करने पर shift हो गया है। जैसे-जैसे AI models का size बढ़ता जा रहा है और training clusters हजारों GPU तक पहुंच रहे हैं, interconnect layer mission-critical infrastructure बन जाती है। Data center processors और networking chips में Marvell की expertise उन्हें उस समस्या को हल करने में key player की position देती है जो AI की सबसे महंगी infrastructure challenge बनती जा रही है।

$2 बिलियन का आंकड़ा सुझाता है कि यह सिर्फ financial investment नहीं बल्कि AI stack के अधिक हिस्से को control करने पर strategic bet है। हालांकि मूल reporting में specific technical collaboration या product roadmaps की details नहीं हैं, timing industry-wide concerns के साथ align करती है large-scale AI deployments में bandwidth limitations को लेकर। Competing perspectives प्रदान करने वाले additional sources के बिना, हमारे पास potential regulatory implications या competitive responses में limited visibility है।

AI applications बनाने वाले developers के लिए, यह partnership eventually बेहतर performance और distributed training और inference workloads के लिए कम costs का मतलब हो सकती है। लेकिन तुरंत benefits की उम्मीद न करें — इस तरह की hardware partnerships को typically 18-24 महीने लगते हैं shipping products produce करने में जो production deployments के लिए matter करते हैं।