Três grandes grupos da indústria financeira estão exigindo ação federal contra fraude alimentada por IA depois que incidentes de deepfake mirando instituições financeiras saltaram 700% em 2023. A American Bankers Association, Better Identity Coalition e Financial Services Sector Coordinating Council lançaram um documento conjunto descrevendo dez categorias de ataques que agora atingem bancos, desde chamadas deepfake em tempo real até campanhas de phishing geradas por IA. A Deloitte projeta que perdas de fraude habilitadas por IA podem chegar a $40 bilhões até 2027, subindo de $12,3 bilhões em 2023.

A história real aqui não são os números de fraude—é que LLMs tornaram ataques de phishing 95% mais baratos mantendo as mesmas taxas de sucesso das campanhas manuais. Quando 60% das pessoas caem vítimas de phishing automatizado por IA, estamos olhando uma mudança fundamental na economia do cibercrime. Autenticação legada como códigos SMS e notificações push já eram vulneráveis a phishing; IA apenas tornou explorar essas fraquezas lucrativo em escala.

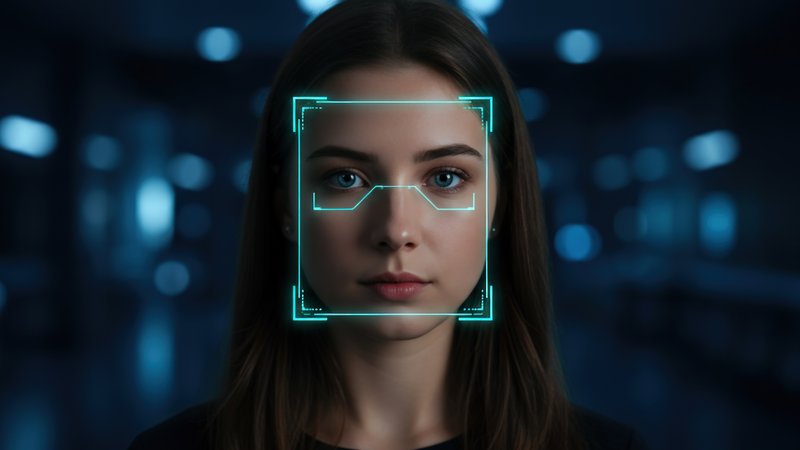

A solução dos grupos foca em autenticação criptográfica—especificamente carteiras de motorista móveis usando criptografia assimétrica de chave pública. O raciocínio deles é sólido: você não pode fazer deepfake da posse de uma chave privada. Eles também estão pressionando para expandir o sistema Electronic Consent-Based verification da Social Security Administration além de suas limitações atuais focadas em crédito para casos de uso mais amplos de validação de identidade.

Para desenvolvedores construindo sistemas de autenticação, isso é um alerta. Se você ainda está dependendo de SMS ou mesmo notificações push para verificação de identidade, você está construindo sobre areia movediça. A janela para implementar verificação de identidade criptográfica não está fechando—ela já fechou. A questão é se formuladores de políticas se moverão rápido o suficiente para padronizar esses sistemas antes que as perdas de fraude piorem.