O New York Times publicou na quinta-feira um perfil elogioso da Medvi, uma startup farmacêutica alimentada por IA supostamente a caminho de $1,8 bilhão em vendas com apenas dois funcionários. O artigo, que apresentava elogios de Sam Altman da OpenAI, posicionou o fundador Matthew Gallagher como um visionário que construiu um império de prescrições GLP-1 usando inteligência artificial. Mas o Times perdeu um detalhe crucial: Futurism expôs a Medvi como uma fábrica de fraude há oito meses.

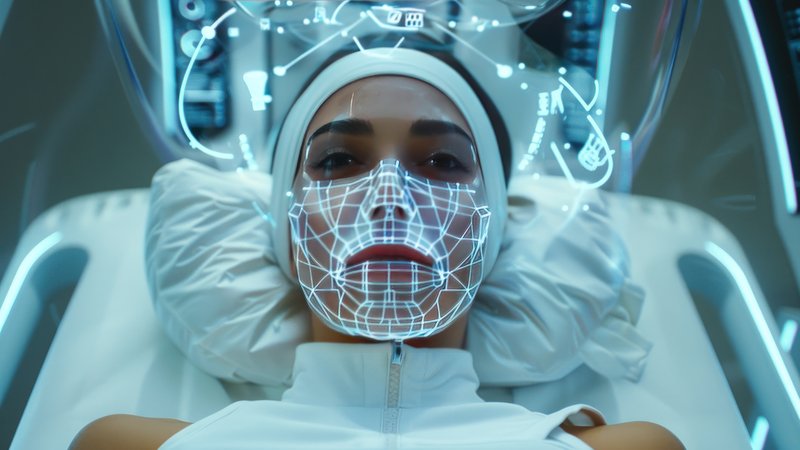

A investigação da Futurism revelou que a Medvi usa perfis de médicos falsos gerados por IA, fotos de antes e depois roubadas com rostos trocados por IA, e depoimentos enganosos para vender medicamentos para emagrecimento. Uma "história de sucesso" apresentava a jornada de perda de peso de um usuário do Reddit de 2017—alcançada parando de beber, não com GLP-1s—com um rosto alterado por IA. Um médico que a Medvi alegava como parceiro exigiu sua remoção do site, dizendo que não tinha nenhum envolvimento. A FDA emitiu avisos sobre as práticas da empresa.

Isso não é apenas jornalismo desleixado—é um padrão perigoso. Veículos principais cada vez mais tratam negócios alimentados por IA como inerentemente inovadores sem examinar suas práticas reais. Quando o Times legitima empresas que usam IA para fabricar credenciais médicas falsas e depoimentos de pacientes, normaliza fraude como disrupção. A história real não é sobre eficiência de IA; é sobre como IA generativa permite enganação sofisticada em escala em indústrias regulamentadas como saúde.

Para desenvolvedores construindo ferramentas de IA: isso é exatamente por que práticas de IA responsáveis importam. Cada detector de deepfake, cada sistema de autenticação de conteúdo, cada proteção ética que você constrói ajuda a prevenir que IA se torne um multiplicador de fraude. A tecnologia que pode automatizar negócios legítimos pode facilmente automatizar golpes—e aparentemente enganar jornalistas de negócios no processo.