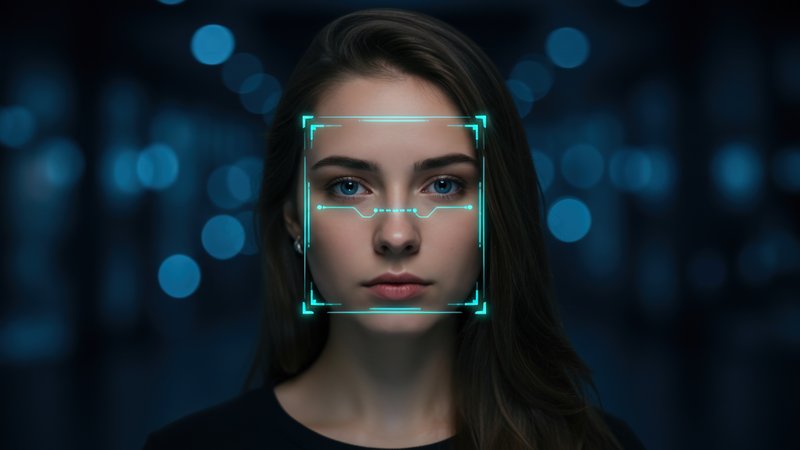

O OkCupid deu à empresa de reconhecimento facial Clarifai acesso a quase 3 milhões de fotos de usuários mais dados de localização sem avisar os usuários ou obter consentimento, revelou a FTC em um acordo anunciado ontem. A empresa-mãe do app de relacionamentos Match Group concordou com restrições permanentes no compartilhamento de dados mas não paga penalidade financeira alguma pelo incidente de 2014. A Clarifai, que comercializa serviços de IA para clientes "militares, civis, de inteligência e governamentais", recebeu os dados sem restrições contratuais sobre como poderiam ser usados.

Este caso expõe como dados de treinamento de IA são coletados de apps de consumo através de acordos secretos que usuários nunca veem. Enquanto empresas de reconhecimento facial falam publicamente sobre IA ética, estão silenciosamente construindo datasets de perfis de relacionamentos, redes sociais e outras fontes pessoais. A FTC descobriu que o OkCupid violou diretamente sua própria política de privacidade, que prometia não compartilhar informações pessoais sem notificação ao usuário e opções de exclusão. O que é particularmente preocupante: o OkCupid "tomou medidas extensivas para ocultar" o compartilhamento de dados e tentou obstruir a investigação da FTC.

O acordo sem penalidade reflete a abordagem de fiscalização mais leve da administração Trump—ambos comissários democratas da FTC tinham sido demitidos, deixando republicanos em controle total. Isso estabelece um precedente preocupante onde empresas podem secretamente alimentar firmas de IA com dados de usuários, serem pegas anos depois, e sair apenas com uma promessa de não fazer de novo. Para desenvolvedores construindo com API de reconhecimento facial, isso destaca a procedência turva de dados de treinamento de fornecedores principais.

Se você está usando Clarifai ou serviços similares, faça perguntas difíceis sobre fontes de dados. As fotos alimentando seus modelos de IA podem vir de apps de relacionamentos, redes sociais ou outros serviços de consumo onde usuários nunca consentiram com treinamento de IA. A resposta fraca da FTC aqui basicamente dá sinal verde para esta prática contanto que empresas eventualmente prometam ser mais transparentes.