El cofundador de Anthropic confirmó que la empresa informó a la administración Trump sobre Mythos, su último modelo de IA que la empresa afirma posee capacidades avanzadas de ciberseguridad. La presentación representa uno de los primeros compromisos directos conocidos entre las principales empresas de IA y la nueva administración, señalando qué tan rápido los actores de la industria se están posicionando con el gobierno entrante.

Este movimiento destaca la creciente intersección del desarrollo de IA y la política de seguridad nacional. Aunque Anthropic ha construido su reputación en la seguridad de IA y el despliegue responsable, la disposición de la empresa a informar a oficiales gubernamentales sobre aplicaciones de ciberseguridad sugiere un cambio estratégico hacia demostrar valor concreto a las comunidades de defensa e inteligencia. El timing es notable — llegando mientras la administración Trump ha señalado una postura más agresiva en regulación tecnológica y competitividad nacional en IA.

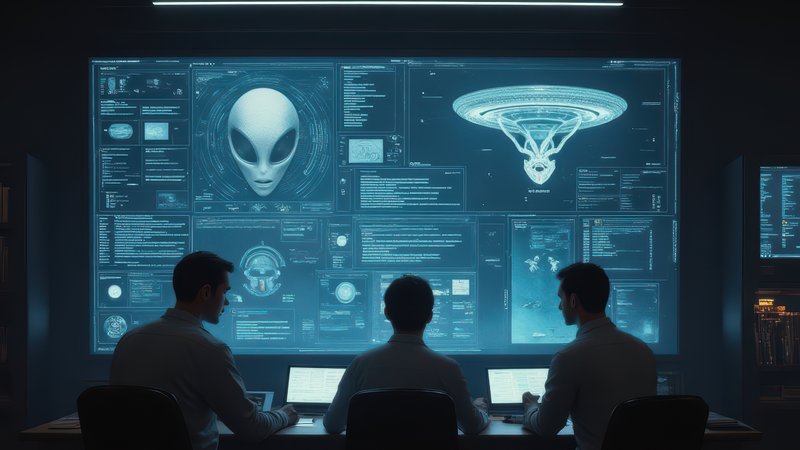

La falta de detalles técnicos alrededor de Mythos plantea preguntas sobre qué demostró exactamente Anthropic. "Poderosas capacidades de ciberseguridad" es jerga de marketing que podría significar cualquier cosa desde escaneo de vulnerabilidades hasta operaciones cibernéticas ofensivas. Sin especificidades sobre la arquitectura del modelo, datos de entrenamiento o benchmarks reales de rendimiento, es imposible evaluar si estas afirmaciones representan un avance genuino o posicionamiento estratégico.

Para desarrolladores y profesionales de IA, esto señala una tendencia más amplia: las empresas de IA están cada vez más enmarcando sus capacidades a través de una lente de seguridad nacional para mantener relaciones gubernamentales y favor regulatorio. Esperen más modelos promocionados con aplicaciones de ciberseguridad, defensa o inteligencia mientras las empresas buscan alinearse con las prioridades que emerjan de Washington.