Um acordo FTC silencioso de março de 2026 está produzindo uma consequência alta essa semana: a Clarifai deletou três milhões de fotos obtidas do OkCupid em 2014, mais todo modelo treinado com elas. A Reuters quebrou a história, o TechCrunch pegou. O arranjo de compartilhamento de dados começou quando o fundador e CEO da Clarifai Matthew Zeiler mandou um e-mail para um colega: "Estamos coletando dados agora e acabamos de perceber que o OKCupid deve ter uma ENORME quantidade de dados incríveis." Executivos do OkCupid detinham participação na Clarifai na época, o que é o tipo de conflito de interesse que parece pior em 2026 do que em 2014.

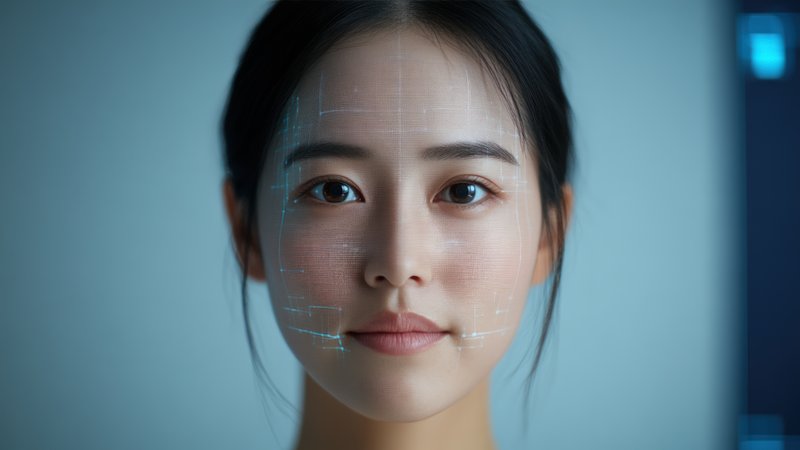

As consequências no lado da IA são mais interessantes que a deleção de fotos em si. Três milhões de fotos de rostos é um conjunto de treinamento útil mas não sem precedentes; a Clarifai tem muitos dados. O acordo FTC também deletou todo modelo treinado com os dados do OkCupid, o que é uma categoria diferente e muito mais difícil. Deleção de modelo em 2026 significa: pesos foram, embeddings foram, fine-tunes derivados desses modelos foram, mais qualquer classificador derivado ou deployment de cliente que dependia deles. Um artigo de 2019 do New York Times originalmente expôs que a Clarifai tinha construído ferramentas estimando idade, sexo, e raça a partir de rostos usando esse dataset — esses são exatamente o tipo de modelos que geram deployments downstream, e é aí que a limpeza fica cara e incompleta na prática.

Dois pontos legais valem nomear. Um, a FTC não pôde impor uma penalidade financeira. Essa é uma "primeira ofensa desse tipo" sob o estatuto deles, e eles só podem exigir conformidade e proibições. OkCupid e Match Group estão permanentemente proibidos de deturpar ou assistir outros a deturpar como dados são coletados e compartilhados. Eles não admitiram as alegações. Dois, a lacuna de doze anos entre o apanhamento de dados de 2014 e a consequência de 2026 é um lembrete de que a responsabilidade de dados de treinamento roda em escalas de tempo longas. A história do NYT de 2019 disparou a investigação FTC; o acordo de março de 2026 produziu a deleção real esse mês. Se você treina com dados de usuário hoje, o relógio começa agora, e a meia-vida é mais longa que a maioria dos modelos que você envia.

Duas coisas para registrar para builders. Um, o resultado "delete os modelos, não só as fotos" é o template regulatório emergente. Isso é como se parece realmente o direito ao esquecimento estilo GDPR quando aplicado a sistemas ML. Sua documentação de linhagem de dados (qual modelo foi treinado com qual dataset, qual deployment usa qual modelo) é agora um artefato legal, não uma cortesia de governança; se você não consegue produzir essa linhagem no cronograma de um regulador, você vai acabar deletando mais modelos do que precisa, defensivamente. Dois, participações cruzadas de executivos entre empresas geradoras de dados e empresas treinadoras de IA são agora uma classe de responsabilidade concreta. O e-mail do Zeiler não era incriminador porque era cru. Era incriminador porque executivos do OkCupid tinham ações na Clarifai, fazendo o compartilhamento de dados parecer auto-negócio em vez de uma integração legítima. A postura "confia em nós, temos uma política de privacidade" não está se sustentando legalmente quando os investimentos e os e-mails contam uma história diferente.