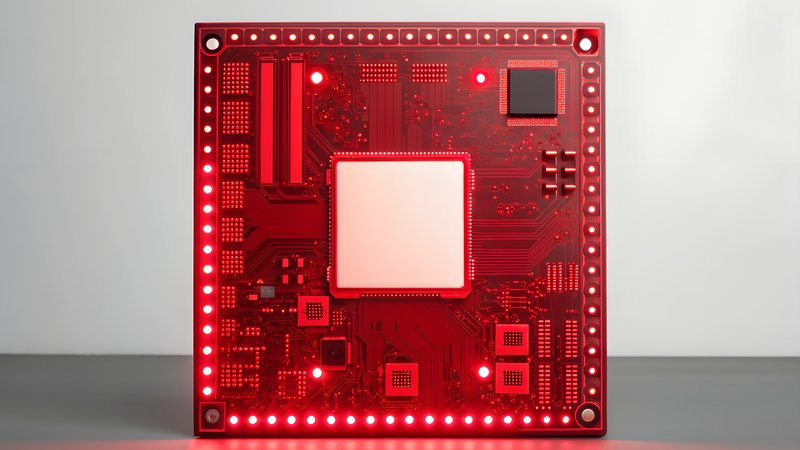

Meta a annoncé une expansion massive de son partenariat avec Broadcom, s'engageant à déployer un gigawatt de processeurs IA personnalisés — assez pour alimenter une petite ville. L'entente prolonge leur collaboration existante sur les accélérateurs IA maison de Meta, signalant le pari de l'entreprise sur le silicium personnalisé plutôt que les GPU standard pour entraîner ses modèles de nouvelle génération.

Cette démarche souligne un changement crucial dans la stratégie d'infrastructure IA. Pendant que l'industrie obsède sur la disponibilité des GPU, Meta résout un goulot d'étranglement différent : la bande passante d'interconnexion. À mesure que les modèles évoluent vers la gamme des billions de paramètres, la vraie contrainte n'est pas la puissance de calcul mais à quelle vitesse les puces peuvent communiquer entre elles. Les processeurs personnalisés de Meta, conçus spécifiquement pour ses charges de travail, peuvent optimiser à la fois le silicium et les protocoles de communication.

D'autres reportages révèlent que ça fait partie d'une course aux armements d'infrastructure plus large. Meta a séparément signé une entente de 6 milliards $ avec Corning pour la fibre optique et la connectivité haute densité — le problème du "mur de cuivre" qui limite la vitesse de déplacement des signaux électriques entre processeurs. Pendant ce temps, des rapports contradictoires suggèrent qu'OpenAI explore aussi des partenariats de puces personnalisées, mais avec différents fournisseurs et stratégies.

Pour les développeurs, cette tendance du silicium personnalisé signifie que le paysage IA se fragmente. Le matériel optimisé de Meta performera probablement mieux avec les modèles et frameworks de Meta, créant de nouvelles dépendances de plateforme. Si vous développez sur l'infrastructure de Meta ou utilisez leurs modèles ouverts, attendez-vous à des avantages de performance. Mais ça signifie aussi moins de portabilité et plus d'enfermement propriétaire alors que chaque acteur majeur optimise toute sa pile du silicium au logiciel.