Meta ने Broadcom के साथ अपनी साझेदारी का बड़ा विस्तार घोषित किया है, एक गीगावॉट custom AI processors तैनात करने की प्रतिबद्धता जताई है — एक छोटे शहर को power करने के लिए पर्याप्त। यह deal Meta के in-house AI accelerators पर उनके मौजूदा collaboration को बढ़ाता है, यह दिखाते हुए कि कंपनी अपनी next-generation models को train करने के लिए off-the-shelf GPUs के बजाय custom silicon पर दांव लगा रही है।

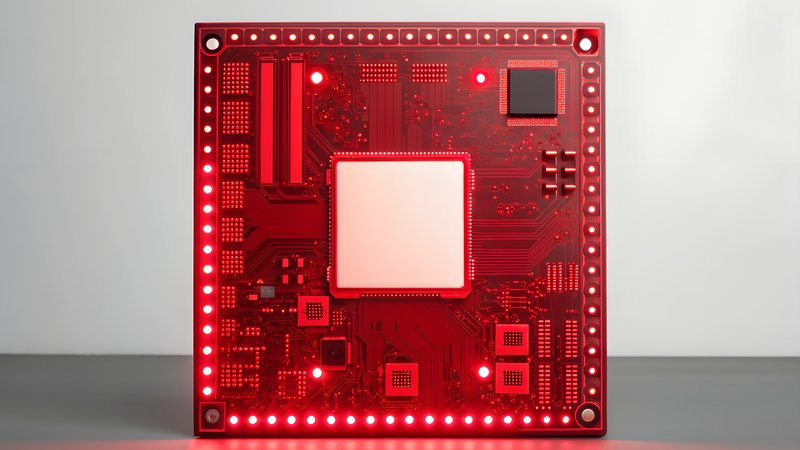

यह move AI infrastructure strategy में एक critical shift को highlight करता है। जबकि industry GPU availability को लेकर obsess कर रहा है, Meta एक अलग bottleneck solve कर रहा है: interconnect bandwidth। जैसे-जैसे models trillion-parameter range में scale करते हैं, असली constraint compute power नहीं बल्कि यह है कि chips आपस में कितनी तेजी से बात कर सकते हैं। Meta के custom processors, जो specifically इसके workloads के लिए design किए गए हैं, silicon और communication protocols दोनों को optimize कर सकते हैं।

अन्य reporting से पता चलता है कि यह एक broader infrastructure arms race का हिस्सा है। Meta ने अलग से Corning के साथ optical fiber और high-density connectivity के लिए $6 billion का deal किया है — "copper wall" problem जो processors के बीच electrical signals की speed को limit करती है। इस बीच, conflicting reports suggest करते हैं कि OpenAI भी custom chip partnerships explore कर रहा है, हालांकि अलग vendors और strategies के साथ।

Developers के लिए, यह custom silicon trend का मतलब है कि AI landscape fragment हो रहा है। Meta का optimized hardware संभवतः Meta के models और frameworks के साथ best perform करेगा, नई platform dependencies create करते हुए। यदि आप Meta के infrastructure पर build कर रहे हैं या उनके open models use कर रहे हैं, तो performance advantages की expect करें। लेकिन इसका मतलब कम portability और ज्यादा vendor lock-in भी है क्योंकि हर major player अपना पूरा stack silicon से software तक optimize कर रहा है।