Google DeepMind lanzó Vision Banana el viernes, un modelo de visión generalista construido por instruction-tuning de Nano Banana Pro (el generador de imágenes detrás de Gemini 3 Pro Image) sobre una mezcla de sus datos de entrenamiento originales más una cantidad modesta de datos de tareas de visión. La afirmación técnica es inusual. En vez de entrenar cabezas separadas para segmentación, estimación de profundidad y predicción de normales de superficie, Vision Banana parametriza el espacio de salida de cada tarea como una imagen RGB y deja que el generador base las produzca directamente. En segmentación semántica de Cityscapes reporta mean Intersection-over-Union de 0.699, una mejora absoluta de 4.7 puntos sobre SAM 3 de Meta en 0.652. He Kaiming y Xie Saining, dos de los autores más citados en investigación de visión moderna, están listados en el paper. La tesis central declarada en el título del paper es directa: los generadores de imágenes son aprendices de visión generalistas.

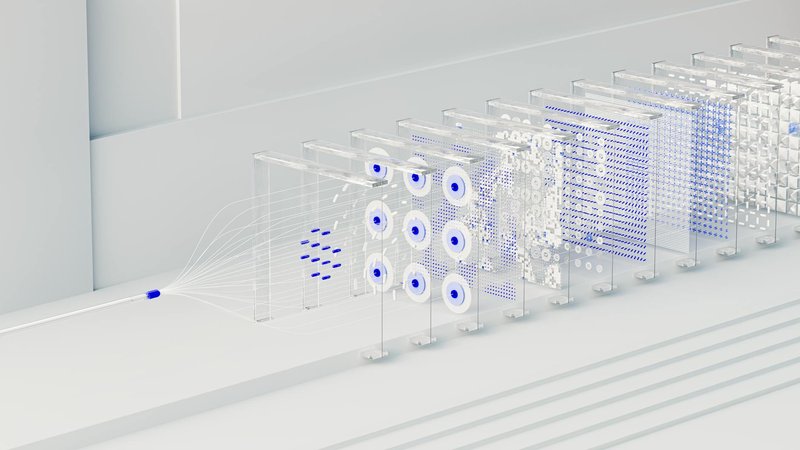

El argumento arquitectural importa más que el benchmark titular. La visión por computadora clásica ha pasado dos décadas construyendo decodificadores específicos de tarea: cabezas de predicción densa para segmentación, cabezas de regresión para profundidad, cabezas de clasificación para detección de objetos. Cada una mapea la representación de características de un backbone a un formato de salida específico de tarea. Vision Banana descarta ese andamiaje al representar cada salida de tarea como imagen y reutilizar el pathway de generación de imágenes del modelo base. Las máscaras de segmentación son imágenes RGB. Los mapas de profundidad son imágenes RGB. Las normales de superficie son imágenes RGB. La capacidad del modelo de producir imágenes coherentes se reutiliza como la capacidad de producir predicciones densas a nivel de píxel en cualquier tarea que admita una representación pictórica. Ese truco no es nuevo (Painter de Microsoft y SegGPT exploraron territorio similar en 2023), pero Vision Banana es la primera instancia donde el generador subyacente está a escala frontera y el generalista resultante supera a los especialistas de dominio.

La implicación de investigación ML es que el preentrenamiento generativo captura estructuras útiles para tareas discriminativas a un nivel más profundo de lo que el campo generalmente asumía. SAM 3 es un especialista fuertemente ingenierizado con segmentación anclada en conceptos y predicción de máscaras agnóstica de clases; perder 4.7 puntos mIoU a un generalista es el tipo de resultado que sugiere que la arquitectura especialista no estaba capturando algo que el generador ya sabía. Ese argumento se ha hecho para lenguaje desde GPT-3, donde el preentrenamiento generativo superaba a modelos NLP específicos de tarea benchmark tras benchmark. Vision Banana es la versión más limpia de ese argumento para visión por computadora. Si el resultado se mantiene bajo evaluación independiente a través de más datasets y modalidades, la consecuencia práctica es que la próxima generación de sistemas de visión se parecerá menos a pipelines especializados y más a generadores de imágenes con prompts y instrucciones de tarea.

Para builders, el impacto inmediato es limitado porque Vision Banana es investigación, no un producto enviado, y los pesos del modelo subyacentes a Nano Banana Pro no están públicamente publicados. La implicación a más largo plazo es más interesante. Si la generación de imágenes es genuinamente una interfaz unificada para comprensión y producción, la estructura de costo de construir sistemas de visión cambia. Hoy, un pipeline CV de producción a menudo combina un backbone, varias cabezas específicas de tarea, datos de entrenamiento y etiquetas separadas para cada tarea, y pegamento de integración. El encuadre de Vision Banana colapsa eso en un solo generador seguidor de instrucciones con salidas condicionadas a la tarea. Construir, por ejemplo, una stack de percepción de conducción autónoma encima de uno de esos modelos reemplazaría cuatro o cinco pipelines de entrenamiento con uno, y le permitiría al sistema manejar tareas novedosas (predecir profundidad del agua, identificar parches de reflejo, etc.) solo dando prompts en lugar de reentrenar. Eso es conceptualmente limpio. Si coincide con la calidad de ingeniería de pipelines especialistas bajo restricciones críticas de seguridad es la próxima cosa que la comunidad de investigación tendrá que probar.