Google DeepMind a sorti Vision Banana vendredi, un modèle vision généraliste construit en instruction-tunant Nano Banana Pro (le générateur d'images derrière Gemini 3 Pro Image) sur un mélange de ses données d'entraînement originales plus une quantité modeste de données de tâches vision. La revendication technique est inhabituelle. Plutôt que d'entraîner des têtes séparées pour la segmentation, l'estimation de profondeur et la prédiction de normales de surface, Vision Banana paramétrise l'espace de sortie de chaque tâche comme une image RGB et laisse le générateur de base les produire directement. Sur la segmentation sémantique Cityscapes, il rapporte un mean Intersection-over-Union de 0,699, une amélioration absolue de 4,7 points sur SAM 3 de Meta à 0,652. He Kaiming et Xie Saining, deux des auteurs les plus cités en recherche vision moderne, sont listés sur le papier. La thèse centrale énoncée dans le titre du papier est directe: les générateurs d'images sont des apprenants vision généralistes.

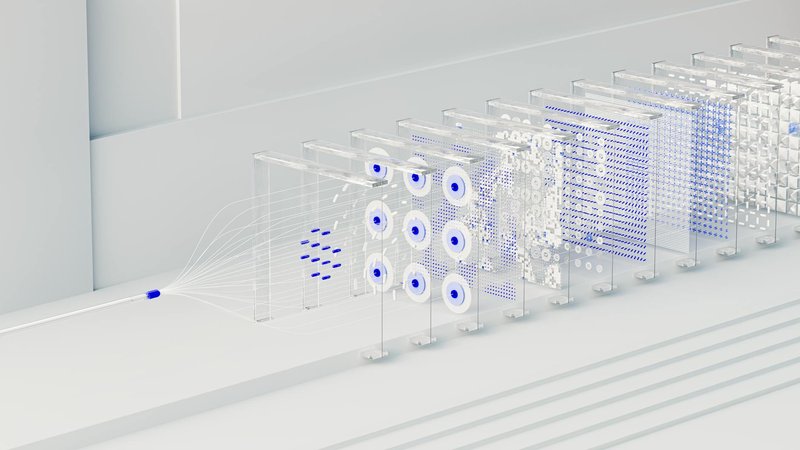

L'argument architectural compte plus que le benchmark titre. La vision par ordinateur classique a passé deux décennies à construire des décodeurs spécifiques aux tâches: têtes de prédiction dense pour la segmentation, têtes de régression pour la profondeur, têtes de classification pour la détection d'objets. Chacune mappe la représentation de caractéristiques d'un backbone vers un format de sortie spécifique à la tâche. Vision Banana abandonne cet échafaudage en représentant chaque sortie de tâche comme une image et en réutilisant le pathway de génération d'images du modèle de base. Les masques de segmentation sont des images RGB. Les cartes de profondeur sont des images RGB. Les normales de surface sont des images RGB. La capacité du modèle à produire de l'imagerie cohérente est réutilisée comme la capacité à produire des prédictions denses au niveau pixel dans toute tâche qui admet une représentation picturale. Ce truc n'est pas nouveau (Painter de Microsoft et SegGPT exploraient un territoire similaire en 2023), mais Vision Banana est la première instance où le générateur sous-jacent est à l'échelle frontière et le généraliste résultant bat les spécialistes de domaine.

L'implication recherche ML, c'est que le pré-entraînement génératif capture des structures utiles pour les tâches discriminatives à un niveau plus profond que le champ supposait généralement. SAM 3 est un spécialiste fortement ingénié avec segmentation ancrée en concepts et prédiction de masques agnostique aux classes; perdre 4,7 points mIoU à un généraliste est le genre de résultat qui suggère que l'architecture spécialiste ne capturait pas quelque chose que le générateur savait déjà. Cet argument a été fait pour le langage depuis GPT-3, où le pré-entraînement génératif surpassait les modèles NLP spécifiques aux tâches benchmark après benchmark. Vision Banana est la version plus propre de cet argument pour la vision par ordinateur. Si le résultat tient sous évaluation indépendante à travers plus de datasets et modalités, la conséquence pratique est que la prochaine génération de systèmes vision ressemblera moins à des pipelines spécialisés et plus à des générateurs d'images promptés avec des instructions de tâches.

Pour les builders, l'impact immédiat est limité parce que Vision Banana est de la recherche, pas un produit livré, et les poids du modèle sous-jacents à Nano Banana Pro ne sont pas publiquement publiés. L'implication à plus long terme est plus intéressante. Si la génération d'images est vraiment une interface unifiée pour la compréhension et la production, la structure de coût de construction de systèmes vision change. Aujourd'hui, un pipeline CV de production combine souvent un backbone, plusieurs têtes spécifiques aux tâches, des données d'entraînement et labels séparés pour chaque tâche, et de la colle d'intégration. Le cadrage de Vision Banana effondre ça en un seul générateur suiveur d'instructions avec sorties conditionnelles à la tâche. Construire, par exemple, une stack de perception conduite autonome au-dessus d'un tel modèle remplacerait quatre ou cinq pipelines d'entraînement par un, et laisserait le système gérer des tâches novelles (prédire la profondeur de l'eau, identifier les patches de reflet, etc.) en juste promptant plutôt qu'en réentraînant. C'est conceptuellement propre. Si ça correspond à la qualité d'ingénierie des pipelines spécialistes sous contraintes safety-critical est la prochaine chose que la communauté de recherche devra tester.