Google DeepMind周五发布了Vision Banana,这是一个通过对Nano Banana Pro(支撑Gemini 3 Pro Image的图像生成器)指令微调构建的通用视觉模型,混合了其原始训练数据加上少量视觉任务数据。技术主张不同寻常。Vision Banana不是为分割、深度估计和表面法线预测训练单独的头,而是将每个任务的输出空间参数化为RGB图像,让基础生成器直接生成它们。在Cityscapes语义分割上,它报告mean Intersection-over-Union为0.699,比Meta SAM 3的0.652绝对提升4.7点。何恺明和谢赛宁——现代视觉研究中两位被引用最多的作者——列在论文中。论文标题中陈述的核心论点很直接:图像生成器是通用视觉学习者。

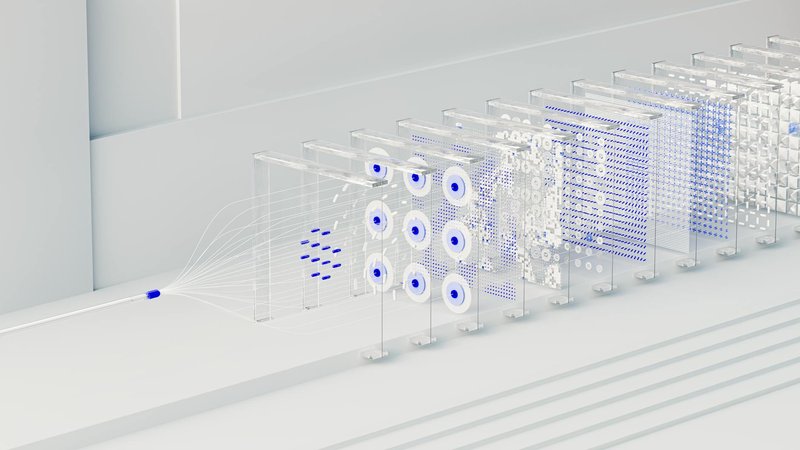

架构论点比标题基准测试更重要。经典计算机视觉花了二十年构建任务特定解码器:分割的密集预测头、深度的回归头、目标检测的分类头。每个都将backbone的特征表示映射到任务特定的输出格式。Vision Banana通过将每个任务输出表示为图像并重用基础模型的图像生成路径,抛弃了这种脚手架。分割掩码是RGB图像。深度图是RGB图像。表面法线是RGB图像。模型生成连贯图像的能力被重新用作在任何允许图形表示的任务中产生像素级密集预测的能力。这个技巧并不新颖(Microsoft的Painter和SegGPT在2023年探索过类似领域),但Vision Banana是首个底层生成器处于前沿规模、产生的通用模型击败领域专家的实例。

ML研究的含义是,生成式预训练捕获了对判别任务有用的结构,其深度超出了该领域通常假设的水平。SAM 3是一个高度工程化的专家,具有概念锚定分割和类别不可知的掩码预测;输给一个通用模型4.7 mIoU点的结果暗示专家架构没有捕获生成器已经知道的东西。这个论点自GPT-3以来已经为语言做过,那里生成式预训练在一个又一个基准上超越了任务特定的NLP模型。Vision Banana是该论点针对计算机视觉的更干净版本。如果结果在更多数据集和模态的独立评估下成立,实际后果就是下一代视觉系统看起来不那么像专门管线,而更像是用任务指令提示的图像生成器。

对builders来说,直接影响有限,因为Vision Banana是研究而非已发布产品,而Nano Banana Pro底层的模型权重未公开发布。长期含义更有趣。如果图像生成确实是理解和生产的统一接口,那么构建视觉系统的成本结构就会改变。今天,一个生产CV管线通常结合一个backbone、几个任务特定头、每个任务的单独训练数据和标签,以及集成胶水。Vision Banana的定性将其折叠成一个单一的指令遵循生成器,具有任务条件输出。比如说,在这样一个模型之上构建自动驾驶感知栈将用一个替代四或五个训练管线,并将让系统通过仅提示而不是重新训练来处理新任务(预测水深、识别反射斑块等)。这在概念上很干净。它是否在安全关键约束下匹配专家管线的工程质量,是研究社区接下来必须测试的事情。