Google DeepMind週五發布了Vision Banana,這是一個透過對Nano Banana Pro(支撐Gemini 3 Pro Image的圖像生成器)指令微調建構的通用視覺模型,混合了其原始訓練資料加上少量視覺任務資料。技術主張不同尋常。Vision Banana不是為分割、深度估計和表面法線預測訓練單獨的頭,而是將每個任務的輸出空間參數化為RGB圖像,讓基礎生成器直接生成它們。在Cityscapes語意分割上,它報告mean Intersection-over-Union為0.699,比Meta SAM 3的0.652絕對提升4.7點。何愷明和謝賽寧——現代視覺研究中兩位被引用最多的作者——列在論文中。論文標題中陳述的核心論點很直接:圖像生成器是通用視覺學習者。

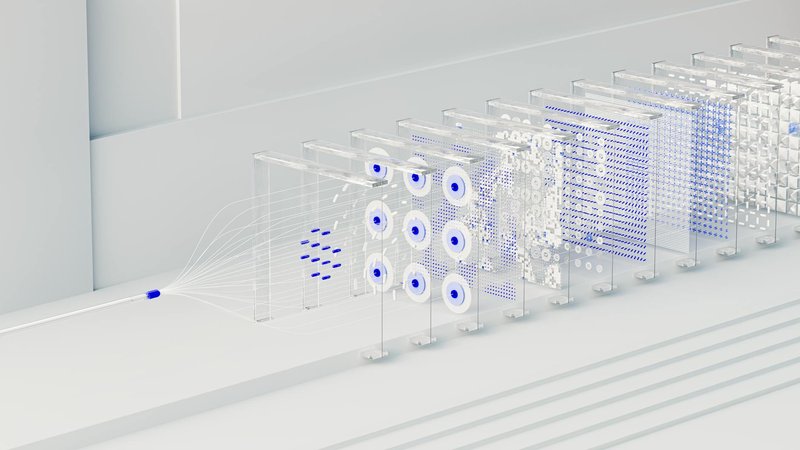

架構論點比標題基準測試更重要。經典電腦視覺花了二十年建構任務特定解碼器:分割的密集預測頭、深度的回歸頭、目標偵測的分類頭。每個都將backbone的特徵表示對應到任務特定的輸出格式。Vision Banana透過將每個任務輸出表示為圖像並重用基礎模型的圖像生成路徑,拋棄了這種鷹架。分割遮罩是RGB圖像。深度圖是RGB圖像。表面法線是RGB圖像。模型生成連貫圖像的能力被重新用作在任何允許圖形表示的任務中產生像素級密集預測的能力。這個技巧並不新穎(Microsoft的Painter和SegGPT在2023年探索過類似領域),但Vision Banana是首個底層生成器處於前沿規模、產生的通用模型擊敗領域專家的實例。

ML研究的含義是,生成式預訓練捕獲了對判別任務有用的結構,其深度超出了該領域通常假設的水平。SAM 3是一個高度工程化的專家,具有概念錨定分割和類別不可知的遮罩預測;輸給一個通用模型4.7 mIoU點的結果暗示專家架構沒有捕獲生成器已經知道的東西。這個論點自GPT-3以來已經為語言做過,那裡生成式預訓練在一個又一個基準上超越了任務特定的NLP模型。Vision Banana是該論點針對電腦視覺的更乾淨版本。如果結果在更多資料集和模態的獨立評估下成立,實際後果就是下一代視覺系統看起來不那麼像專門管線,而更像是用任務指令提示的圖像生成器。

對builders來說,直接影響有限,因為Vision Banana是研究而非已發布產品,而Nano Banana Pro底層的模型權重未公開發布。長期含義更有趣。如果圖像生成確實是理解和生產的統一介面,那麼建構視覺系統的成本結構就會改變。今天,一個生產CV管線通常結合一個backbone、幾個任務特定頭、每個任務的單獨訓練資料和標籤,以及整合膠水。Vision Banana的定性將其折疊成一個單一的指令遵循生成器,具有任務條件輸出。比如說,在這樣一個模型之上建構自動駕駛感知棧將用一個替代四或五個訓練管線,並將讓系統透過僅提示而不是重新訓練來處理新任務(預測水深、識別反射斑塊等)。這在概念上很乾淨。它是否在安全關鍵約束下匹配專家管線的工程品質,是研究社群接下來必須測試的事情。