SAP ha adquirido Dremio y Prior Labs en un solo anuncio, con un compromiso separado de $1,17B en cuatro años al desarrollo de Prior Labs. El encuadre estratégico viene del CTO de SAP Philipp Herzig: *"La IA enterprise no se atasca porque los modelos no sean lo bastante buenos; se atasca porque los datos no están listos."* Ese es el split piso-vs-techo que ha estado definiendo silenciosamente la IA enterprise por dos años — los labs frontera empujan el techo de capacidad del modelo, pero las empresas queman presupuestos en poner sus datos tabulares en un estado donde cualquier modelo pueda usarlos productivamente. SAP está comprando ambas capas en un solo movimiento.

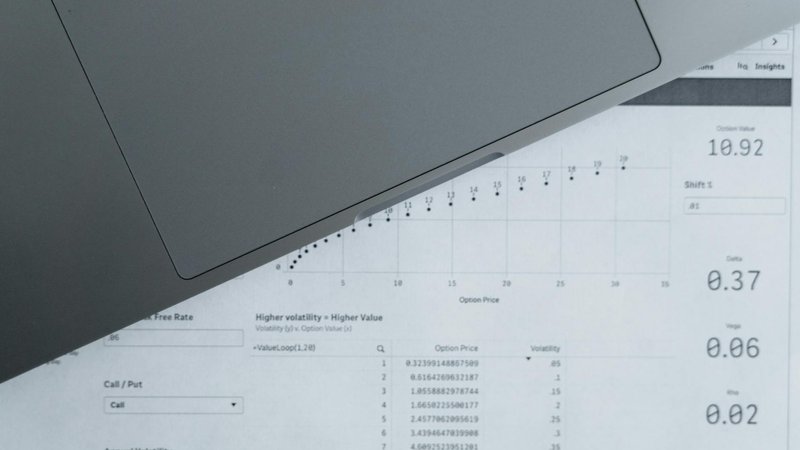

Dremio trae un data lakehouse con dos tecnologías open-source que importan para el ecosistema más amplio: Apache Iceberg (formato de tabla columnar con control de versiones, el estándar abierto emergente) y Apache Polaris (gestión de metadatos para tablas Iceberg). Más un agente IA integrado que permite a los usuarios consultar sin escribir SQL. Prior Labs trae TabPFN-2.5 — un transformer específicamente optimizado para datos tabulares, haciendo aprendizaje in-context en lugar de entrenamiento por tarea, capaz de procesar hasta 100.000 filas de hoja de cálculo por tarea. Hay también un motor de distilación que genera algoritmos ligeros específicos del dataset a partir del modelo base. Objetivo de integración: Business Data Cloud de SAP; rutas de integración HANA, Datasphere y Joule no fueron divulgadas. Sin términos financieros sobre las adquisiciones individuales; los $1,17B/4 años son el compromiso para desarrollo TabPFN, no precio de compra.

Para devs, la señal estructural es que la IA tabular es la frontera subatendida. Imagen, texto y código atraen la atención porque las apps consumer y el tooling dev son la superficie de marketing, pero los datos en filas-y-columnas son donde vive la mayor parte de los datos enterprise, y los enfoques de modelo que funcionan para texto no estructurado no transfieren limpiamente a cargas tabulares. El enfoque de aprendizaje-in-context de TabPFN (sin fine-tuning por dataset, solo alimentar la tabla en inferencia) es significativamente diferente del enfoque LLM-sobre-tablas que la mayoría de vendors enterprise venían entregando. SAP apostando $1,17B en cuatro años a este equipo es validación real de que los enfoques transformer-específico-tabular son comercialmente viables, no solo un thread académico. Vigila si Snowflake, Databricks y Microsoft Fabric contramoverán con sus propios juegos de modelos fundación tabulares.

Si construyes productos IA enterprise, la implicación práctica es que el stack se está bifurcando: modelos labs frontera para cargas no estructuradas, modelos tabular-específicos para cargas estructuradas, y la capa lakehouse (Iceberg + Polaris + Delta Lake) volviéndose el sustrato estándar. Si entregas retrieval contra datos tabulares, los modelos estilo TabPFN de aprendizaje in-context vale evaluarlos contra tu enfoque actual LLM-con-herramientas-SQL — la forma de latencia y costo es significativamente diferente, y a menudo mejor para tablas de alta cardinalidad. Si mantienes un proyecto open-source en el espacio lakehouse, SAP comprometiéndose tan fuerte con Iceberg es alcista para la gravedad de ese formato vs Delta Lake o Hudi. La historia real no es que SAP hizo adquisiciones; es que articularon la IA tabular como un stack separado valiendo $1,17B de inversión dedicada.