SAP 在一份公告里同时收购了 Dremio 与 Prior Labs,并另外承诺四年内向 Prior Labs 投入 11.7 亿美元。战略定调来自 SAP CTO Philipp Herzig:*「企业 AI 卡住,从来不是因为模型不够好;是因为数据没准备好。」* 这就是过去两年里悄悄定义企业 AI 的「天花板 vs 地板」之分 —— 前沿实验室在推「模型能力的天花板」,而企业真实在烧的预算,是把自己手里的表格数据弄到「任何一个模型都用得上」的那个状态。SAP 这次,等于是把两层一起买下来。

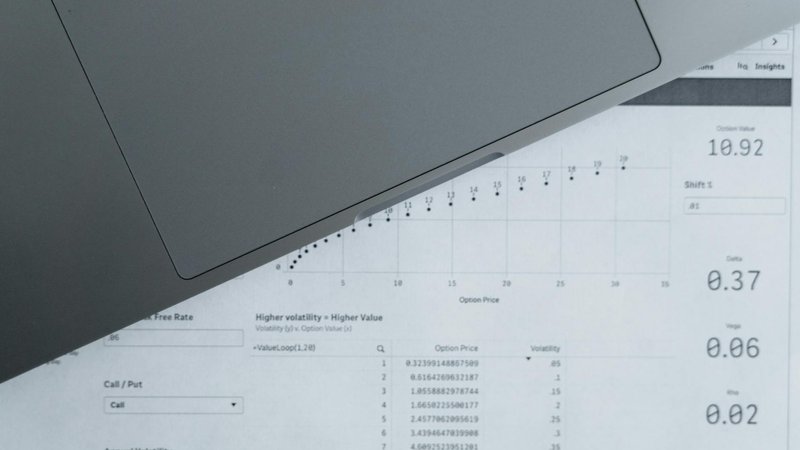

Dremio 带来的是一座数据湖仓,关键是底下那两块开源技术:Apache Iceberg(带版本控制的列式表格格式,正在成为开放标准)和 Apache Polaris(针对 Iceberg 表的元数据管理)。再加上一个内建 AI agent,用户不用写 SQL 也能查询。Prior Labs 带来的是 TabPFN-2.5 —— 专门为表格数据优化的 transformer,做的是「上下文学习」(in-context learning),不再为每个数据集做单独 fine-tune,推理时把表喂进去就行,每任务上限大约 10 万行。它还带一个蒸馏引擎,从基模出发,自动产出针对每个具体数据集的轻量级算法版本。整合目标是 SAP 的 Business Data Cloud;HANA、Datasphere、Joule 的整合路径没有披露。两笔收购各自的财务条款没公开;那个「四年 11.7 亿美元」是承诺给 TabPFN 的研发投入,不是收购价。

对开发者而言,结构性信号是:表格 AI 是个一直被低估的前线。图像、文本、代码之所以拿走全部注意力,是因为它们是消费级应用和开发者工具的营销面;但「行 + 列」结构化数据,才是大多数企业数据真正所在,而那些在非结构化文本上行得通的模型路径,迁到表格工作负载上并不能干净地复制。TabPFN 那种「不再每个数据集单独 fine-tune,推理时把整张表当上下文喂进去」的路径,跟过去两年大多数企业供应商在卖的「LLM 套上 SQL 工具」路径,是有意义不同的两条路。SAP 用四年 11.7 亿美元押在这个团队身上,是实打实地验证「面向表格的 transformer 路径」在商业上行得通,不只是学术线。接下来值得盯的是 Snowflake、Databricks、Microsoft Fabric 会不会跟上自己的「表格基础模型」反招。

如果你在做企业级 AI 产品,可落地的含义是:技术栈正在分叉成两条 —— 非结构化负载走「前沿实验室模型」,结构化负载走「表格专用模型」,而湖仓层(Iceberg + Polaris + Delta Lake)正在成为统一的底层基质。如果你做的是「针对表格数据的检索」,那 TabPFN 这一类「上下文学习」的模型,值得拿来跟你当前的「LLM + SQL 工具」方案做一次正经评估 —— 它的延迟与成本曲线和 LLM 路径差得不少,在高基数表上往往还更好。如果你在维护湖仓领域的开源项目,SAP 把这么重的注押在 Iceberg 上,对 Iceberg 之于 Delta Lake、Hudi 的「重力」是利好。真正的故事不是「SAP 又做了两笔收购」;而是「他们正式把表格 AI 当作一个独立的栈,值得 11.7 亿美元的专项投入」。