SAP a acquis Dremio et Prior Labs dans une seule annonce, avec un engagement séparé de 1,17 G$ sur quatre ans pour le développement de Prior Labs. Le cadrage stratégique vient du CTO de SAP Philipp Herzig : *« L'IA enterprise ne stalle pas parce que les modèles ne sont pas assez bons; elle stalle parce que les données ne sont pas prêtes. »* C'est le split plancher-vs-plafond qui définit silencieusement l'IA enterprise depuis deux ans — les labos frontières poussent le plafond de capacité du modèle, mais les entreprises brûlent des budgets à mettre leurs données tabulaires dans un état où n'importe quel modèle peut les utiliser productivement. SAP achète les deux couches d'un seul coup.

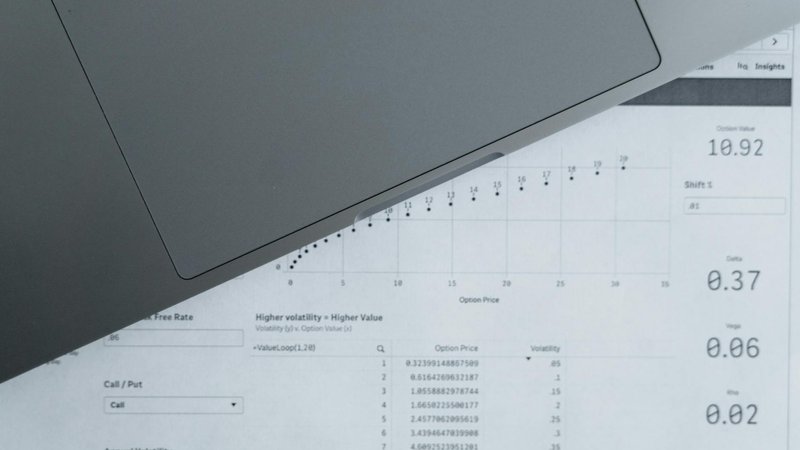

Dremio apporte un data lakehouse avec deux technologies open-source qui comptent pour l'écosystème plus large : Apache Iceberg (format de table colonnaire avec contrôle de version, le standard ouvert émergent) et Apache Polaris (gestion de métadonnées pour tables Iceberg). Plus un agent IA intégré qui laisse les utilisateurs requêter sans écrire de SQL. Prior Labs apporte TabPFN-2.5 — un transformer spécifiquement optimisé pour les données tabulaires, qui fait de l'apprentissage in-context plutôt qu'un entraînement par tâche, capable de traiter jusqu'à 100 000 lignes de tableur par tâche. Il y a aussi un moteur de distillation qui génère des algorithmes légers spécifiques au dataset à partir du modèle de base. Cible d'intégration : Business Data Cloud de SAP; les chemins d'intégration HANA, Datasphere et Joule n'ont pas été divulgués. Pas de termes financiers sur les acquisitions individuelles; les 1,17 G$ sur 4 ans, c'est l'engagement pour le développement TabPFN, pas le prix de rachat.

Pour les développeurs, le signal structurel est que l'IA tabulaire est la frontière sous-desservie. L'image, le texte et le code attirent l'attention parce que les apps grand public et l'outillage dev sont la surface marketing, mais les données en lignes-et-colonnes c'est où la majeure partie des données enterprise vivent, et les approches modèle qui marchent pour le texte non-structuré ne transfèrent pas proprement aux charges de travail tabulaires. L'approche apprentissage-in-context de TabPFN (pas de fine-tuning par dataset, juste feed la table à l'inférence) est significativement différente de l'approche LLM-sur-tables que la plupart des vendors enterprise livraient. SAP qui parie 1,17 G$ sur quatre ans sur cette équipe est une vraie validation que les approches transformer-spécifique-tabulaire sont viables commercialement, pas juste un thread académique. Surveille si Snowflake, Databricks et Microsoft Fabric contre-bougeront avec leurs propres jeux de modèles fondations tabulaires.

Si tu bâtis des produits IA enterprise, l'implication pratique est que le stack se bifurque : modèles labos frontières pour les charges non-structurées, modèles tabulaire-spécifiques pour les charges structurées, et la couche lakehouse (Iceberg + Polaris + Delta Lake) qui devient le substrat standard. Si tu livres du retrieval contre des données tabulaires, les modèles style TabPFN à apprentissage in-context valent le coup d'être évalués contre ton approche actuelle LLM-avec-outils-SQL — la forme de latence et de coût est significativement différente, et souvent meilleure pour les tables à haute cardinalité. Si tu maintiens un projet open-source dans l'espace lakehouse, SAP qui s'engage aussi fort sur Iceberg, c'est haussier pour la gravité de ce format vs Delta Lake ou Hudi. La vraie histoire, ce n'est pas que SAP a fait des acquisitions; c'est qu'ils ont articulé l'IA tabulaire comme un stack séparé valant 1,17 G$ d'investissement dédié.