SAP 在一份公告裡同時收購了 Dremio 與 Prior Labs,並另外承諾四年內向 Prior Labs 投入 11.7 億美元。戰略定調來自 SAP CTO Philipp Herzig:*「企業 AI 卡住,從來不是因為模型不夠好;是因為資料沒準備好。」* 這就是過去兩年裡悄悄定義企業 AI 的「天花板 vs 地板」之分 —— 前沿實驗室在推「模型能力的天花板」,而企業真實在燒的預算,是把自己手裡的表格資料弄到「任何一個模型都用得上」的那個狀態。SAP 這次,等於是把兩層一起買下來。

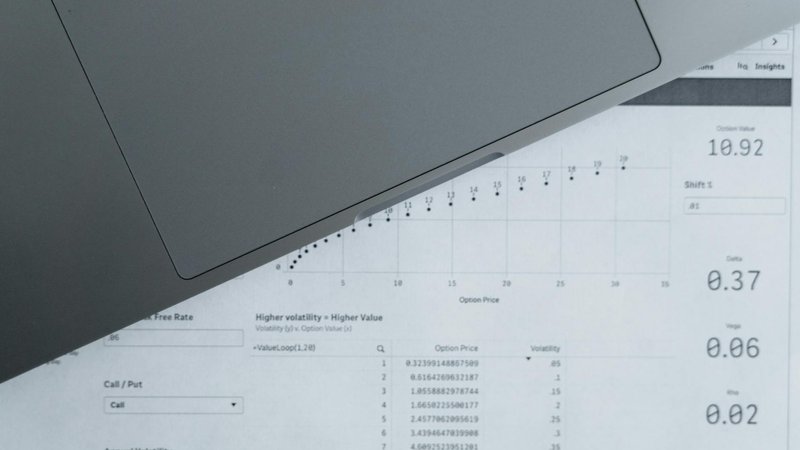

Dremio 帶來的是一座資料湖倉,關鍵是底下那兩塊開源技術:Apache Iceberg(帶版本控制的列式表格格式,正在成為開放標準)和 Apache Polaris(針對 Iceberg 表的中繼資料管理)。再加上一個內建 AI agent,使用者不用寫 SQL 也能查詢。Prior Labs 帶來的是 TabPFN-2.5 —— 專門為表格資料最佳化的 transformer,做的是「上下文學習」(in-context learning),不再為每個資料集做單獨 fine-tune,推論時把表餵進去就行,每任務上限大約 10 萬列。它還帶一個蒸餾引擎,從基模出發,自動產出針對每個具體資料集的輕量級演算法版本。整合目標是 SAP 的 Business Data Cloud;HANA、Datasphere、Joule 的整合路徑沒有披露。兩筆收購各自的財務條款沒公開;那個「四年 11.7 億美元」是承諾給 TabPFN 的研發投入,不是收購價。

對開發者而言,結構性訊號是:表格 AI 是個一直被低估的前線。影像、文字、程式碼之所以拿走全部注意力,是因為它們是消費級應用和開發者工具的行銷面;但「列 + 欄」結構化資料,才是大多數企業資料真正所在,而那些在非結構化文字上行得通的模型路徑,遷到表格工作負載上並不能乾淨地複製。TabPFN 那種「不再每個資料集單獨 fine-tune,推論時把整張表當上下文餵進去」的路徑,跟過去兩年大多數企業供應商在賣的「LLM 套上 SQL 工具」路徑,是有意義不同的兩條路。SAP 用四年 11.7 億美元押在這個團隊身上,是實打實地驗證「面向表格的 transformer 路徑」在商業上行得通,不只是學術線。接下來值得盯的是 Snowflake、Databricks、Microsoft Fabric 會不會跟上自己的「表格基礎模型」反招。

如果你在做企業級 AI 產品,可落地的含義是:技術棧正在分叉成兩條 —— 非結構化負載走「前沿實驗室模型」,結構化負載走「表格專用模型」,而湖倉層(Iceberg + Polaris + Delta Lake)正在成為統一的底層基質。如果你做的是「針對表格資料的檢索」,那 TabPFN 這一類「上下文學習」的模型,值得拿來跟你當前的「LLM + SQL 工具」方案做一次正經評估 —— 它的延遲與成本曲線和 LLM 路徑差得不少,在高基數表上往往還更好。如果你在維護湖倉領域的開源專案,SAP 把這麼重的注押在 Iceberg 上,對 Iceberg 之於 Delta Lake、Hudi 的「重力」是利多。真正的故事不是「SAP 又做了兩筆收購」;而是「他們正式把表格 AI 當作一個獨立的棧,值得 11.7 億美元的專項投入」。